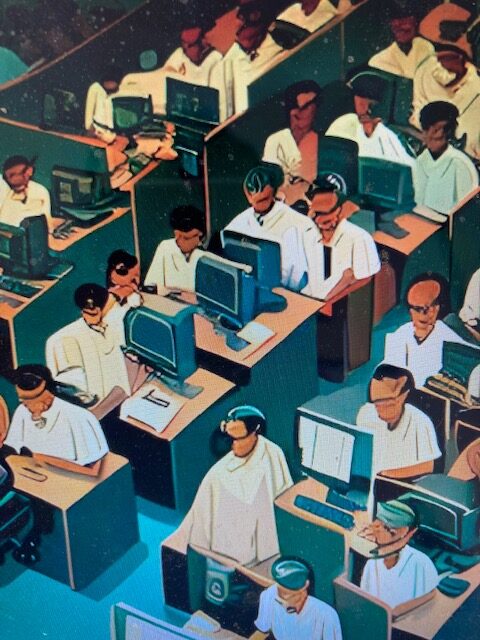

ll n’y a pas que des robots derrière l’intelligence artificielle (IA) : en bout de chaîne, on trouve souvent des travailleurs des pays du sud. Récemment une enquête du Time révélait que des travailleurs kényans payés moins de trois euros de l’heure étaient chargés de s’assurer que les données utilisées pour entraîner ChatGPT ne comportaient pas de contenu à caractère discriminatoire.

Les modèles d’IA ont en effet besoin d’être entraînés, en mobilisant une masse de données extrêmement importante, pour leur apprendre à reconnaître leur environnement et à interagir avec celui-ci. Ces données doivent être collectées, triées, vérifiées et mises en forme. Ces tâches chronophages et peu valorisées sont généralement externalisées par les entreprises technologiques à une foule de travailleurs précaires, généralement situés dans les pays des suds.

Ce travail de la donnée prend plusieurs formes, en fonction des cas d’usage de l’algorithme final, mais il peut s’agir par exemple d’entourer les personnes présentes sur les images capturées par une caméra de vidéosurveillance, pour apprendre à l’algorithme à reconnaître un humain. Ou encore corriger manuellement les erreurs produites par un modèle de traitement automatique de factures.